Діпфейки стають все більшою загрозою для демократичних процесів у світі, викликаючи занепокоєння щодо їхнього впливу на вибори та довіру суспільства. Різні країни розробляють власні стратегії для боротьби з цією проблемою, поєднуючи законодавчі заходи, технологічні інновації та освітні програми. В цій аналітиці Центру демократії та верховенства права ми розглянемо детальніше ці законодавчі кроки та проаналізуємо їх.

Останні декілька років люди все частіше бачать, як технології штучного інтелекту допомагають в пришвидшенні процесів та дають нам безліч можливостей зробити нашу повсякденність краще. Проте зловмисники не стоять осторонь і активно користуються цими технологіями для власних маніпуляцій. Нещодавно вонио використали діпфейк, видаючи себе за екс-міністра закордонних справ України Дмитра Кулебу під час розмови з головою Комітету із закордонних справ США, Бенджаміном Кардіном. Діпфейк ставив питання, що стосувалися майбутніх виборів, однак Кардін вчасно зрозумів обман і припинив розмову. Цей інцидент демонструє, як діпфейки можуть використовуватися для маніпуляцій на високому рівні, що підкреслює важливість ретельного регулювання та заходів безпеки для запобігання подібним випадкам.

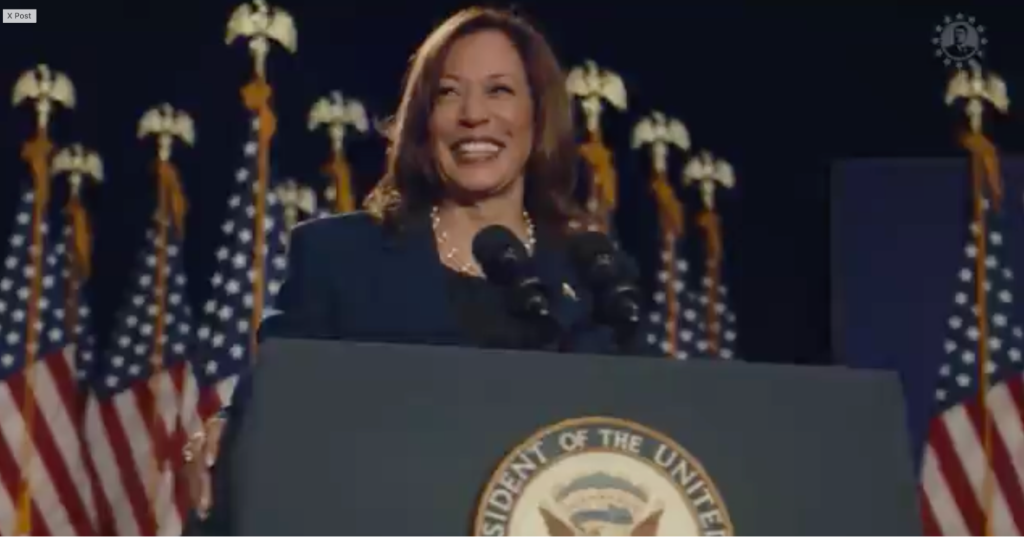

Також нещодавно Ілон Маск опублікував відео, створене за допомогою технології DeepFake, за участі Камали Харріс. У відео вона саркастично називає себе “найкращим варіантом різноманіття”, звинувачує критиків у сексизмі та расизмі і заявляє, що “була маріонеткою” протягом 4 років. Маск репостнув це відео з акаунту “МР Рікан USA”, де відео було позначене як пародія, що відповідало вимогам платформи X. Проте на у дописі Ілона Маска на його акаунті відповідного повідомлення не було, натомість залишилось лише його доповнення: “Це дивовижно” та смайлик. Відповідно до правил платформи X “Користувачі не можуть ділитися синтетичними, маніпуляційними або вирваними з контексту медіа, які можуть ввести в оману або заплутати людей і завдати шкоди («оманливі медіа»).”

Джерело: акаунт на платформі X Ілона Маска

Цей випадок демонструє небезпеку використання технології DeepFake, оскільки багато людей можуть сприйняти таке відео за оригінальне, навіть якщо це пародія. Невідповідне позначення або відсутність попереджень може дезінформувати аудиторію та призвести до маніпуляцій громадською думкою, що особливо небезпечно в контексті політики та суспільної довіри.

Також показовим є те, як нещодавно представники країни-агресора використали діпфейк Олексія Данілова, де він начебто коментує теракт, який трапився на їх території.

Зрозуміло, що в багатьох людей виникає питання, що роблять держави, аби зменшити поширення такого контенту. В контексті цього можемо розглянути, як діють законодавці на території різних держав.

У Сполучених Штатах Америки (далі – США) боротьба з діпфейками ведеться як на федеральному рівні, так і на рівні окремих штатів. Наприклад, Каліфорнія прийняла закон AB-730 (2019), який забороняє розповсюдження сфабрикованих аудіо або відео про кандидатів протягом 60 днів до виборів без чіткого розкриття. Цей закон спрямований на захист виборців від маніпуляцій та забезпечення належного виборчого процесу.

Техас прийняв подібний закон SB-751 (2019), що забороняє навмисне створення та розповсюдження діпфейків з метою впливу на вибори.

Якщо звернути увагу на більш нещодавні ініціативи, то варто розглянути The Nurture Originals, Foster Art, and Keep Entertainment Safe Act of 2023 або No Fakes Act – законопроект від 2023 року. Його метою є запобігання тому, щоб без згоди особи або власника прав створювалась цифрова копія.

Цей законопроєкт не поширюється на цифрові копії, якщо вони є частиною новинних репортажів, громадських обговорень, спортивних трансляцій, документальних/біографічних робіт. Водночас, законопроєкт передбачає винятки для комерційної діяльності такої як реклама, якщо вона пов’язана з новинними матеріалами, документальними фільмами або пародіями. Окрім цього такі форми творчого самовираження, як сатира, пародії та критика не підпадають під заборону. Велика частина творців контенту підтримала цей законопроект.

Закони на кшталт SB-751 у Техасі та No Fakes Act 2023 свідчать про зростаюче усвідомлення небезпек діпфейків, особливо в контексті виборів та прав на цифрові копії. No Fakes Act спрямований на захист інтелектуальної власності та персональних даних, встановлюючи чіткі обмеження на створення цифрових копій без згоди. При цьому законопроєкт робить винятки для новин, документальних матеріалів та творчих робіт, що зберігає баланс між захистом прав і свободою творчого самовираження.

Нещодавно і в Каліфорнії почали активно працювати над законодавством щодо регулювання штучного інтелекту. Зокрема мова йде про нещодавній законопроект, який передбачає, що компанії повинні тестувати свої моделі, запобігати маніпуляціям людьми та розкривати протоколи безпеки. Він орієнтований на системи, що потребують понад 100 мільйонів доларів для навчання. Прихильники цього законопроекту вважають, що він міг би встановити необхідні правила для безпечного використання ШІ. Проте деякі компанії, такі як OpenAI, Google та Meta, висловили заперечення щодо нього. Таким чином стало зрозуміло, що він викликає сильну протидію з боку великих технологічних компаній, проте не всіх. Оскільки наприклад компанія Anthropic підтримала законопроект після внесення певних змін до нього. Після тривалого процесу щодо цього законопроекту губернатор Каліфорнії Гевін Ньюсом використав своє право вето щодо нього. Ньюсом вважає, що такий закон може перешкодити інноваціям і змусити компанії покинути Каліфорнію. Також пояснив такі дії тим, що законопроєкт не враховував рівні ризику для різних систем ШІ та міг би створювати надмірні обмеження навіть для базових функцій. Однак незважаючи на це він оголосив про свої плани захисту суспільства від потенційних ризиків ШІ.

Законопроєкт міг би суттєво вплинути на світову технологічну індустрію, оскільки Каліфорнія є домом для багатьох передових ШІ-компаній, таких як OpenAI. Подібні ініціативи щодо регулювання штучного інтелекту в демонструють складність балансу між інноваціями та безпекою. Хоча законопроект спрямований на встановлення правил для великих ШІ-систем і забезпечення їх безпечного використання, він зустрів значну протидію з боку технологічних гігантів, таких як OpenAI, Google та Meta, а використання губернатором Ньюсомом вето показує, що є побоювання щодо впливу таких регуляцій на інновації та економіку Каліфорнії. Проте це також підкреслює важливість продовження пошуку компромісу між регуляціями та розвитком технологій.

Європейський Союз

В контексті Європейського Союзу головним актом, що регулює функціонування систем штучного інтелекту є Artificial intelligence Act (далі – AI Act). Відповідно до нього діпфейк це “зображення, аудіо або відеоконтент, створений або маніпулювання штучним інтелектом, який нагадує існуючих осіб, об’єкти, місця, організації або події і помилково здається людині автентичним або правдивим”.

AI Act встановлює нові правила для діпфейків, які визначаються як згенерований або змінений штучним інтелектом контент, що виглядає справжнім. Від провайдерів ШІ вимагається забезпечити маркування таких матеріалів у машинно-читаному форматі для полегшення їх розпізнавання. Також користувачі, що розповсюджують ці матеріали, повинні чітко зазначати їх штучне походження. Важливими винятками є художні, сатиричні або кримінально-правові роботи. Мета цих вимог — зменшити ризики дезінформації, забезпечити прозорість і захистити громадян від обману.

Крім маркування контенту, провайдери ШІ повинні використовувати надійні технічні рішення для забезпечення того, щоб кінцевий користувач міг легко відрізнити діпфейки від справжнього контенту. Це можуть бути водяні знаки, метадані або інші методи криптографії, що допомагають підтвердити походження контенту та його автентичність. Такі рішення повинні бути ефективними та не створювати надмірних витрат для провайдерів.

Водночас користувачі систем штучного інтелекту (ті, хто розповсюджує або публікує цей контент) повинні також забезпечувати чітке і зрозуміле позначення штучного походження матеріалів. Важливо, що це правило стосується не лише великих корпорацій, але й приватних осіб, які можуть створювати діпфейки для особистого використання. Проте є винятки для випадків, коли контент використовується з кримінально-правовою метою або є частиною художньої чи сатиричної роботи.

AI Act вимагає від організацій розробки кодексів поведінки для виконання нових правил, а також Європейська комісія може затвердити такі кодекси, або встановити загальні правила щодо їх впровадження. Ці заходи спрямовані на те, щоб забезпечити ефективну боротьбу з дезінформацією та зберегти довіру до інформаційного середовища в ЄС.

У свою чергу в Китаї 10 січня 2023 року набули чинності Положення про адміністрування глибокого синтезу інформаційних послуг на основі Інтернету. Вони зобов’язують компанії, що надають послуги створення діпфейків, вимагати ідентифікацію користувачів та чітко зазначати, що контент був створений штучним інтелектом, щоб запобігти плутанині серед громадськості.

А Сінгапур прийняв Закон про захист від онлайн-брехні та маніпуляцій (POFMA, 2019), який надає уряду широкі повноваження вимагати видалення або коригування фейкового контенту. Закон про захист від онлайн-брехні та маніпуляцій (POFMA) у Сінгапурі охоплює широкий спектр онлайн-дезінформації, включаючи фальшивий контент, який може включати діпфейки. Хоча закон не містить спеціального визначення діпфейків, він може бути застосований до будь-якого контенту, який уряд вважає “фальшивим” або “оманливим”. Це включає будь-які форми цифрових маніпуляцій, зокрема відео або зображення, що можуть бути створені або змінені за допомогою штучного інтелекту.

Хоча закон спрямований на боротьбу з дезінформацією, він викликав критику з боку правозахисних організацій щодо можливого придушення свободи слова. Наприклад, Human Rights Watch зазначає, що уряд Сінгапуру застосовує POFMA для блокування критичних новин та обмеження висловлювань, які суперечать його політиці.

Сінгапурський підхід демонструє, як уряди можуть використовувати законодавство для швидкого реагування на загрози діпфейків. Проте важливо, щоб такі заходи не стали інструментом для обмеження законного дискурсу та критики.

Протидія діпфейкам вимагає комплексного підходу, що включає законодавчі, технологічні та освітні заходи. Досвід різних країн демонструє, що жодна стратегія не є універсальною. Важливо продовжувати обмінюватися кращими практиками та розвивати міжнародні стандарти для ефективної боротьби з цією загрозою. Тільки через спільні зусилля можна захистити демократичні процеси та забезпечити стійкість суспільства перед обличчям дезінформації. Зважаючи на це для протидії поширенню діпфейкам варто зважати на наступні важливі напрямки.

Об’єднані Арабські Емірати

До діпфейків в ОАЕ може бути застосовано законодавство, що забороняє обробку персональних даних без явної згоди. Мова йде про Федеральний закон No 45 від 2021 року про захист персональних даних (PDPL). Слід зауважити, що закон не охоплює обробку даних державними установами ОАЕ, а також медичної, банківської та кредитної інформації, оскільки ці сфери регулюються окремими нормативними актами. Також в ОАЕ діє законодавство щодо кіберзлочинності, що карає за поширення особистої інформації або її модифікацію з метою образи чи наклепу. Вищеперелічені правові рамки можуть бути застосовані щодо поширення діпфейків.

Законодавча база ОАЕ, включно з Федеральним законом № 45 від 2021 року (PDPL), створює чіткі рамки для захисту персональних даних, що може ефективно застосовуватися у випадках діпфейків. Наприклад вищезазначений закон, хоча й не охоплює державні установи та окремі сектори, як медичний чи банківський, все одно надає потужний інструмент для регулювання обробки персональних даних і захисту приватності громадян. Додатково, кіберзаконодавство, спрямоване на боротьбу з наклепом та образами, посилює правові можливості для протидії поширенню діпфейків, зокрема у випадках маніпуляції з особистою інформацією з метою завдання шкоди репутації. Такий багаторівневий підхід до захисту даних та протидії кіберзлочинності може слугувати одним з шляхів реалізації механізму для регулювання та боротьби з діпфейками.

Південна Корея

Останніми роками в Південній Кореї значно зросла кількість сексуальних злочинів, пов’язаних з діпфейками. Поліція вже отримала понад 800 таких справ. Разом з цим, місцева поліція активно розслідує діяльність телеграм-ботів, пов’язаних із поширенням фейкових матеріалів. Поштовхом для цього стали 88 випадків розповсюдження діпфейків порнографічного характеру через Telegram.

Це стало однією з причин прийняття законопроєкту, який стосується кримінальної відповідальності за перегляд і зберігання зображень з елементами сексуального насильства, а також відео, створених за допомогою штучного інтелекту. Раніше за подібні дії передбачалося покарання у вигляді позбавлення волі до п’яти років або штраф у розмірі до 50 мільйонів вон, що регулювалося Законом Південної Кореї про запобігання сексуальному насильству та захист жертв. Однак, відповідно до нового законодавства, термін ув’язнення може сягати 7 років, що свідчить про посилення заходів проти подібних злочинів.

З огляду на зростання кількості злочинів, пов’язаних із діпфейками, та інтенсивну роботу правоохоронних органів щодо їхнього розслідування, стає зрозуміло, що боротьба з цим явищем вимагає більш радикального підходу. Прийняття нового законодавства, яке передбачає суворіші покарання за подібні правопорушення, є необхідним кроком у протидії діпфейкам. Однак для ефективної боротьби важливо не лише посилювати відповідальність, але й забезпечувати ефективну роботу правоохоронних органів у кіберпросторі.

Особливу увагу необхідно приділяти платформам, через які відбувається поширення діпфейків. Протидія таким платформам має включати як нормативно-правові заходи, так і технічні рішення, що обмежують можливості розповсюдження шкідливого контенту.

Рекомендації для громадянського суспільства:

- Підвищення медіаграмотності: Проводити навчальні кампанії для громадян щодо розпізнавання діпфейків та інших форм дезінформації.

- Критичне мислення: Сприяти розвитку навичок критичного аналізу інформації, що поширюється в медіа та соціальних мережах.

- Моніторинг і протидія: Створювати ініціативи для активного моніторингу фейкових новин та їх спростування через незалежні платформи та медіа.

Рекомендації для держави:

- Законодавче регулювання: Впроваджувати закони для обмеження створення та поширення діпфейків з маніпулятивною метою.

- Просвітницькі програми: Організовувати державні кампанії з підвищення обізнаності щодо діпфейків і навчати громадян перевіряти джерела інформації.

- Співпраця з приватним сектором: Співпрацювати з технологічними компаніями для розробки стандартів прозорості та маркування ШІ-контенту.ологічними компаніями для розробки стандартів прозорості та маркування ШІ-контенту.