Дмитро Воюта, юрист з медійного права

та захисту персональних даних напряму “Незалежні медіа”

Центру демократії та верховенства права

Розвиток технологій має прямий вплив на інформаційну сферу та медіа. Винайдення друкарського верстату створило умови для небаченого раніше поширення інформації у новій формі та сприяло розвитку преси; вивчення і застосування електромагнітних хвиль дозволило передавати сигнал на відстані за допомогою радіо, телебачення. Проте медіа не лише перебувають під ефектом нових технологій, а і самі впливають на їхній розвиток, адже виступають активним користувачем та своєрідним промоутером, впливають на формування попиту на ці технології. У цьому матеріалі Центр демократії та верховенства права розглядає поточні підходи до регулювання штучного інтелекту в ЄС та як регулювання штучного інтелекту зачіпає інтереси медіа.

Визначення системи координат у ЄС

На міжнародному рівні основи регулювання штучного інтелекту (далі – ШІ) сьогодні закладаються на рівні Європейського Союзу. Розробка спільної політики фактично стартувала ще у 2018 році.

10 квітня 2018 року 25 держав-членів ЄС підписали Декларацію про співпрацю у сфері штучного інтелекту. Пізніше, ще чотири країни приєдналися до ініціативи. Держави-підписанти Декларації погодилися співпрацювати над найважливішими питаннями, які стосуються ШІ:

- забезпечення конкурентоспроможності Європи в дослідженнях і впровадженні ШІ;

- вирішення соціальних, економічних, етичних і правових питань.

Держави констатували, що ШІ може вирішити ключові суспільні виклики, починаючи від сталої охорони здоров’я до зміни клімату, від кібербезпеки до сталої міграції, а сама технологія стає ключовим рушієм економічного зростання завдяки цифровізації промисловості та суспільства в цілому.

Водночас, держави-підписанти Декларації звернули увагу і на виклики, пов’язані із застосуванням ШІ. Вони погодилися, що потрібен випереджувальний підхід, який допоможе впоратися з трансформацією ринку праці, зумовленою ШІ. Необхідно також модернізувати європейські системи освіти та навчання, включаючи підвищення кваліфікації та перекваліфікацію європейських громадян. Слід розглянути і нові юридичні та етичні питання. Навколо розробки та використання штучного інтелекту потрібне середовище довіри та підзвітності, щоб повністю отримати вигоду від можливостей, які він надає.

25 квітня 2018 року Європейська комісія опублікувала комунікаційний лист “Штучний інтелект для Європи”. Документ продовжує задану рамку у підході ЄС до ШІ, яка вдало сформульована у параграфі:

“The European Union (EU) should have a coordinated approach to make the most of the opportunities offered by AI and to address the new challenges that it brings. The EU can lead the way in developing and using AI for good and for all, building on its values and its strengths.” (Європейський Союз (ЄС) повинен мати узгоджений підхід, щоб максимально використати можливості, які пропонує штучний інтелект, та вирішувати нові виклики, які він створює. ЄС може очолити шлях у розробці та використанні штучного інтелекту на благо і для всіх, спираючись на свої цінності та сильні сторони).

Європейська ініціатива щодо ШІ має на меті:

- підвищити технологічний та промисловий потенціал ЄС, посилити вплив ШІ в економіці;

- підготувати держави та громадян до соціально-економічних змін, спричинених ШІ, шляхом заохочення модернізації систем освіти та навчання, а також через передбачення змін на ринку праці, підтримуючи при цьому необхідні зміни на ринку праці та адаптацію системи соціального захисту;

- забезпечити належну етичну та правову базу. Для цього необхідно створити середовище довіри та підзвітності навколо розробки та використання ШІ.

7 грудня 2018 року Європейська комісія презентувала “Координаційний план зі штучного інтелекту”. Цей план пропонує близько 70 заходів для більш тісної та ефективної співпраці між державами-членами та Європейською комісією в ключових сферах, таких як: дослідження, інвестиції, злиття та поглинання на ринку, навички та таланти, дані та міжнародна співпраця. Виконання плану розраховане до 2027 року з регулярним моніторингом і переглядом.

У 2021 році план оновили. План на 2021 рік пов’язаний із цифровими та екологічними пріоритетами Європейської комісії та відповіддю на пандемію COVID-19. Координаційний план 2021 року спрямований на те, щоб перетворити стратегію на дії, спонукаючи до:

- прискорення інвестицій в технології штучного інтелекту задля сприяння стійкому економічному та соціальному відродженню за допомогою впровадження нових цифрових рішень;

- повного та швидкого впровадження програм штучного інтелекту для гарантії того, що ЄС максимізує переваги раннього впровадження ШІ;

- узгодження політики ШІ для усунення фрагментації.

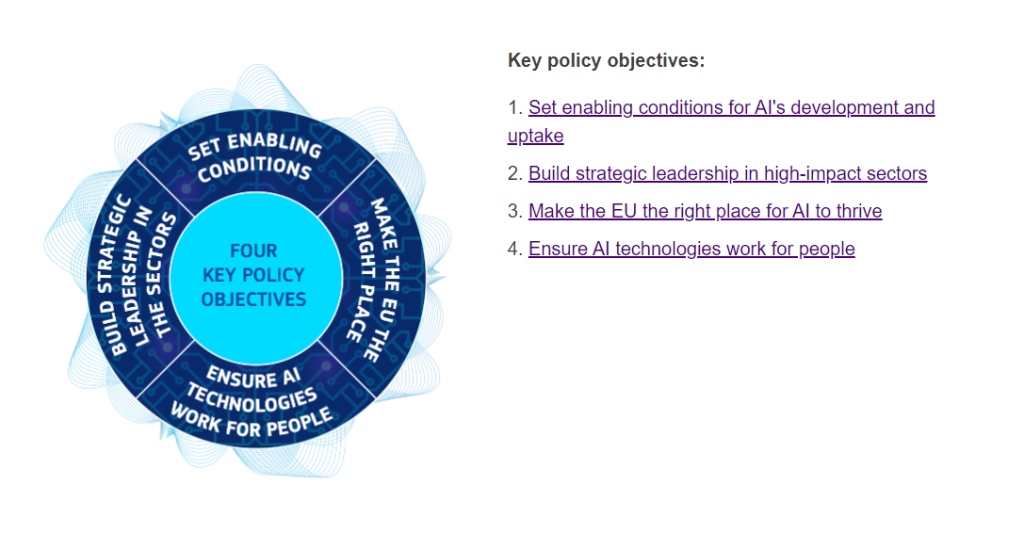

Для досягнення цього в оновленому плані встановлено чотири ключові набори політичних цілей, щодо кожної з яких передбачені конкретні заходи до 2025 року. Передбачені в документі політичні цілі:

- Встановити сприятливі умови для розробки та впровадження ШІ в ЄС.

- Побудувати стратегічне лідерство у секторах з високим впливом.

- Зробити ЄС місцем, де досконалість наскрізна – від місця розробки до ринку.

- Забезпечити, щоб ШІ працював для людей і був силою добра у суспільства.

Джерело: Офіційний вебсайт Європейської комісії

Оновлений План також вказує на можливий механізм фінансування та встановлює часові рамки для досягнення цілей.

У оновленому Плані сфера медіа згадується у цілі – “Зробити ЄС місцем, де досконалість наскрізна – від місця розробки до ринку”. В межах цілі передбачено завдання зі створення та мобілізації дослідницького потенціалу в ЄС. Виконання завдання здійснюватиметься зокрема і шляхом функціонування програми Horizon Europe. Дослідження в рамках програми мають продемонструвати, як ШІ допомагає трансформувати основні економічні сектори виробництва та послуг, які наслідки для ринку праці це матиме, а також яким може бути вирішення основних суспільних проблем у різних сферах, у тому числі і сфері медіа (наводиться приклад проблеми дезінформації).

В рамках програми Horizon 2020 створено мережу центрів, які мають посилити співпрацю між найкращими дослідницькими групами Європи. Одним із центрів є AI4Media, покликаний об’єднати зусилля у вирішенні наукових і технологічних проблем, та сприяти співпраці, інтеграції та синергії між дослідницькими групами та сектором. Цей проєкт зосереджується на вдосконаленні ШІ для обслуговування медіа та забезпеченні того, щоб європейські цінності етичного та надійного ШІ були вбудовані в майбутній розвиток ШІ, а також на переосмисленні ШІ як корисної технології на службі суспільства та медіа.

Іншим важливим стратегічним документом ЄС є документ “Біла книга з штучного інтелекту. Європейський підхід до досконалості і довіри”, представлений 19 лютого 2020 року. За своєю природою біла книга – це стратегічний документ, що окреслює поточний стан, визначає проблему та представляє бачення авторів документу з вирішення описаного питання. Водночас, це бачення не має зобов’язуючого характеру чи юридичної сили.

Представлена Біла книга, як слідує з її назви, деталізує європейський підхід до досконалості (an ecosystem of excellence) та довіри (an ecosystem of trust) у контексті ШІ.

Екосистема досконалості має політичну основу, яка полягає у:

- створенні центрів досконалості та тестування, які можуть поєднувати європейські, національні та приватні інвестиції;

- створенні та підтримці мережі провідних університетів і вищих навчальних закладів з метою залучення професорів та науковців, що дозволить запропонувати провідні світові магістерські програми зі штучного інтелекту;

- функціонуванні принаймні одного центру цифрових інновацій у кожній державі-члені, який має високий ступінь спеціалізації на ШІ;

- створенні нового державно-приватного партнерства у сфері ШІ, даних і робототехніки.

Екосистема довіри має нормативну основу та полягає у:

- дотриманні єдиного підходу до ШІ в усьому ЄС, задля уникнення розбіжностей у вимогах держав-членів, які створюють перешкоди для єдиного ринку;

- пріоритезації ШІ для розвитку економіки та інвестицій;

- застосуванні підходу до регулювання ШІ, який базується на оцінці ризиків і залежить від конкретного сектору, визначення секторів та програм з високим ризиком, включаючи програмне забезпечення для розпізнавання обличчя;

- встановленні нових нормативних вимог та проведення попередньої оцінки для того, щоб упевнитися у відповідності систем ШІ з високим рівнем ризику вимогам безпеки, справедливості та захисту даних, перед випуском таких програм на ринок.

Враховуючи сформовані підходи до регулювання ШІ, у квітні 2021 року Європейська комісія презентувала законопроєкт «Пропозиція щодо Регламенту Європейського парламенту та Ради ЄС про встановлення гармонізованих правил щодо штучного інтелекту (Акт про штучний інтелект) та внесення змін до деяких законодавчих актів Європейського Союзу».

ЦЕДЕМ детально аналізував проєкт Акту про штучний інтелект та його основні положення, запропоновану класифікацію систем ШІ, ризик орієнтований підхід до впровадженні систем ШІ. Експерти ЦЕДЕМ тоді відзначили, що Акт передбачає встановлення системи аудиту та незалежної оцінки впливу штучного інтелекту на права та свободи людини. Це мало б забезпечити вищий рівень захисту прав людини в контексті використання ШІ. Водночас, рекомендувалося не чекати на прийняття Акту, а уже враховувати підходи, закладені в Акті для посилення власної конкурентоспроможності.

В грудні 2023 Європейський парламент та Європейська рада погодили проєкт Акту та врегулювали наявні розбіжності. Зміни врахували потенційні загрози правам громадян і демократії, яку становлять окремі програми ШІ. У зв’язку з цим, співзаконодавці погодилися заборонити:

- системи біометричної категоризації, які використовують чутливі характеристики (наприклад, політичні, релігійні переконання, сексуальну орієнтацію, расову приналежність тощо);

- нецілеспрямоване копіювання зображень обличчя з Інтернету або записів камер відеоспостереження для створення баз даних розпізнавання облич;

- розпізнавання емоцій на робочому місці та в навчальних закладах;

- соціальну оцінку на основі соціальної поведінки або особистих характеристик;

- системи ШІ, які маніпулюють поведінкою людей, щоб обійти їх свободу волі.

Разом із цим, передбачили окремі винятки для правоохоронних органів, пов’язані із застосуванням біометричних систем ідентифікації у загальнодоступних місцях, з метою, наприклад, пошуку особи, засудженої або підозрюваної у вчиненні тяжкого злочину, чи пошуку жертв (йдеться про випадки викрадення, торгівлі людьми, сексуальної експлуатації), запобігання конкретній і поточній терористичній загрозі.

Акт прийняли 13 березня 2024 року – він був схвалений євродепутатами 523 голосами «за», 46 «проти» та 49 утрималися. Його головна мета – захист основоположних прав, демократії, верховенства права та стійкості навколишнього середовища від штучного інтелекту з високим ризиком, одночасно стимулюючи інновації та утверджуючи Європу як лідера у сфері ШІ.

З урахуванням зазначених вище узгоджених у грудні 2023 року змін, положення Акту також передбачають:

- Визначення заборонених систем ШІ (наприклад таких, що маніпулюють поведінкою людей, розпізнають емоції на робочому місці або у школі) та встановлення обмежень для правоохоронних органів на використання систем біометричної ідентифікації особи.

- Визначення систем ШІ високого ризику. До таких систем належать ті, що можуть спричинити значну шкоду здоровʼю, безпеці, навколишньому середовищу, основним правам, демократії та верховенству права.

- Встановлення ряду зобов’язань для систем високого ризику. Наприклад, такі повинні оцінювати та зменшувати ризики, вести журнали використання, бути прозорими та точними, забезпечувати остаточний контроль за людино. Своєю чергою, громадяни зможуть подавати скарги на системи штучного інтелекту та отримувати пояснення щодо рішень, заснованих на системах високого ризику ШІ, які впливають на їхні права.

- Закріплення вимог щодо прозорості систем ШІ. Системи ШІ загального призначення мають відповідати певним вимогам щодо прозорості, включаючи дотримання законодавства ЄС про авторське право та публікацію детального опису вмісту даних, який використовується для навчання ШІ.

- Обов’язковість маркування штучні або оброблені зображення, аудіо- чи відеоконтент («діпфейки») повинні бути чітко позначені як такі. ЦЕДЕМ присвятив цій проблематиці окремий матеріал.

- Заходи з підтримки інновацій та малого і середнього бізнесу. Йдеться про регуляторні «пісочниці» та тестування, необхідні для розробки та навчання інноваційного штучного інтелекту перед його випуском на ринок.

Більшість положень Акту вступають в силу через 24 місяці після набрання ним чинності. Водночас, регулювання заборонених систем ШІ запрацює через шість місяців після дати набрання чинності, штучного інтелекту загального призначення – через 12 місяців, а регулювання систем високого ризику – через 36 місяців. Тож побачити результати від реалізації положень Акту можливо буде лише за декілька років.

Формування рамки взаємовідносин ШІ та медіа на рівні Ради Європи

На рівні Ради Європи з 2021 року розпочалася робота над створенням правової рамки застосування ШІ. Ухвалено створити спеціальний Комітет зі штучного інтелекту, якому доручено розробити акт, який регламентуватиме питання розробки, проектування та застосування систем ШІ на основі стандартів Ради Європи щодо прав людини, демократії та верховенства права.

У лютому 2023 року Комітет оприлюднив «Нульовий проект» Рамкової конвенції про штучний інтелект, права людини, демократію та верховенство права. У грудні 2023 року презентовано проєкт Рамкової конвенції, який містить результати 2-го читання. Цей документ стане основою для третього, останнього читання.

На цьому етапі, застосування Конвенції пропонувалося обмежити у питаннях, пов’язаних з національною безпекою та обороною та роботою приватних розробників штучного інтелекту. В питаннях національної безпеки та оборони державам залишили можливість не застосовувати положення Конвенції щодо прав людини. Саме тому на початку лютого 2024 року ЦЕДЕМ приєднався до відкритого листа організацій громадянського суспільства та підтримав вимоги щодо забезпечення дотримання прав людини у сфері використання технологій штучного інтелекту в приватному секторі.

14 березня 2024 Комітет схвалив текст Рамкової конвенції зі штучного інтелекту, прав людини, демократії та верховенства права. Документ встановлює правову базу, що охоплює системи ШІ протягом усього їх життєвого циклу. Надалі відбувається доопрацювання пояснювального коментаря – “Explanatory report”. У травні 2024 року очікується, що Конвенція буде прийнята на рівні Комітету міністрів Ради Європи, після чого вона буде відкрита для підписання усіма країнами світу.

Іншим документом, підготовленим на рівні Ради Європи є “Керівні принципи щодо відповідального використання ШІ в журналістиці”. Вони були схвалені 30 листопада 2023 року Керівним комітетом з медіа та інформаційного суспільства Ради Європи. Український регулятор сфери медіа – Національна рада України з питань телебачення і радіомовлення також приймала участь у обговоренні проєкту Керівних принципів.

Основні положення Керівних принципів передбачають:

- Рішення про застосування ШІ має бути не просто технологічним чи комерційним, але також відповідати місії медіа. Це рішення є редакційним, оскільки воно має вирішальне значення для реалізації редакційної місії та професійних цінностей медіа. Крім цього, в медіа має бути людина, яка чітко відповідає за впровадження та результати використання журналістського ШІ.

- Оцінка ризиків є важливою для відповідального розвитку та впровадження ШІ в медіа. Новинні медіа повинні мати процедури для визначення та, де це можливо, оцінки та пом’якшення ризиків, враховуючи ризики для прав третіх сторін (наприклад, захист персональних даних, авторське право тощо).

- Відповідальне впровадження та використання ШІ починається з відповідальних закупівель. Обираючи конкретного постачальника технологій штучного інтелекту важливо враховувати, чи розробник ШІ забезпечує відповідальне використання даних, наприклад, законне отримання даних для ШІ.

- ШІ потребує як технічної, так і організаційної інфраструктури для підтримки. Окрім цього, для генеративного ШІ необхідний редакторський нагляд. Це допоможе уникнути неправильних або упереджених процесів роботи і результатів. Нагляд має виходити за рамки перевірки результатів і поширюватися на процеси, які створили ці результати.

- Маркування результатів роботи ШІ. Організації новин повинні повідомляти, коли і як вони використовують системи ШІ. Це слід застосовувати і в ситуаціях, коли використання систем штучного інтелекту може суттєво вплинути на права суб’єкта чи аудиторії чи на інтерпретацію результатів.

- Новинні організації повинні забезпечувати постійне навчання персоналу з використання ШІ, які об’єднують технічних спеціалістів та журналістів, стимулюють обізнаність щодо прав людини (таких як конфіденційність і право не дискримінація) та щодо професійної етики.

- Держави мають позитивне зобов’язання захищати та створювати сприятливі умови для реалізації прав людини та плюралізму медіа. Держави повинні заохочувати незалежні регуляторні органи або органи саморегулювання медіа допомагати розробляти керівні принципи та стандарти для відповідального використання та розвитку журналістського ШІ відповідно до існуючих Керівних принципів.

Висновки

На рівні програмних документів Європейської комісії сформовано загальні підходи до формування політики ЄС щодо ШІ. При цьому, на даному етапі питання медіа, як окремої сфери, не виділяється, а первинним є саме система ШІ та визначення рамок її функціонування. Водночас, сфера медіа є однією зі сфер, що зазнає суттєвого впливу ШІ-технологій та потребує впровадження етичного та надійного ШІ як корисної технології на службі суспільства та медіа задля вирішення суспільних проблем (зокрема, проблеми дезінформації).

Саме тому ЄС забезпечує підтримку реалізації проєкту AI4Media, який фокусується на дослідженнях із застосування ШІ у медіа.

У доповнення до цього, на рівні Ради Європи в останні місяці активно розроблялися одразу два документи, які окреслюють рамку щодо застосування ШІ в роботі медіа. Йдеться про Рамкову конвенцію зі штучного інтелекту, прав людини, демократії та верховенства права, а також про уже схвалені Керівні принципи щодо відповідального використання ШІ в журналістиці. Саме Керівні принципи на сьогодні є найбільш предметним документом, який встановлює своєрідний алгоритм із прийняття рішення